Беше тешко да не се зачудиме на демо-верзијата на најновата надградба на ЧетГПТ. Наместо да прикаже четбот што звучи посигурно, „Опен еј-ај“ му даде на светот верзија што ги погоди сите покорни женски ноти, кикотејќи се на лудоријата на своите машки истражувачи и давајќи комплименти за нивната облека. Бесот што се појави како резултат на сличноста со гласот на Скарлет Јохансон доведе до пропуштање на суштината. Водечките светски развивачи на вештачка интелигенција создаваат софтвер што ги зајакнува стереотипите за жените. И има голема причина зошто: едноставно има премалку вклучени жени.

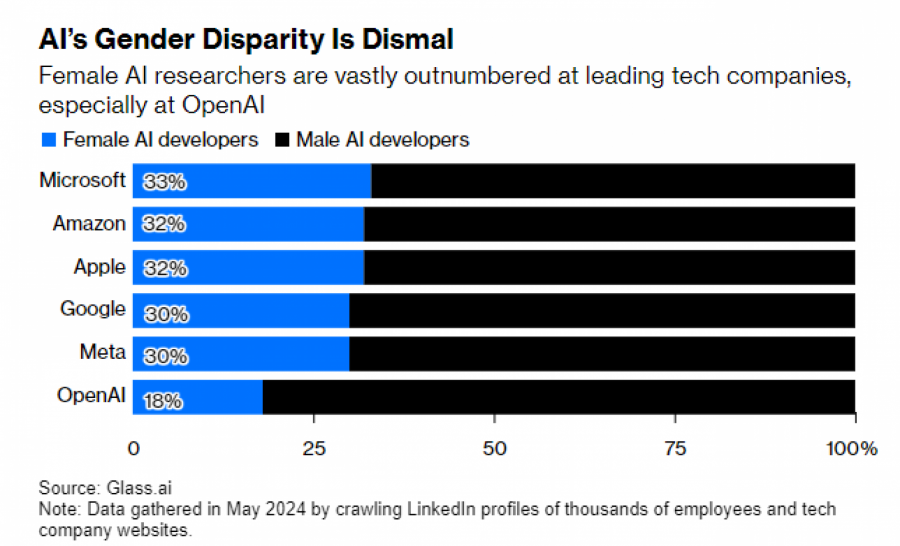

Во „Опен еј-ај“ само 18 отсто од персоналот што работи на развој на технологија се жени, според податоците собрани од фирмата „Глас“ за потребите на „Блумберг опинион“. „Глас“ користела со технологија за машинско учење за да ги испита веб-страниците на технолошките компании и илјадниците профили на Линкдин поврзани со вработени што се фокусирани на вештачката интелигенција. Креаторот на ЧетГПТ е најлош меѓу водечките компании во истражувањето што беше спроведено во мај 2024 година.

Иако главниот директор за технологија на „Опен еј-ај“, Мира Мурати, е жена (и накратко беше извршна директорка за време на минатогодишната драма кога Сем Алтман беше отпуштен), само 122 од 686 вработени во компанијата чии работни места вклучуваат градење системи за вештачка интелигенција се жени. Несовпаѓањето беше уште полошо пред една година, кога „Глас“ направи слично истражување на профилите на Линкдин, откривајќи дека жените сочинуваат само 12 отсто од истражувачкиот персонал на „Опен еј-ај“.

Bloomberg

Bloomberg

Кога жените и етничките малцинства не играат улога во градењето критична технологија, како што е вештачката интелигенција, големи се шансите да дојде до појава на потенцијална пристрасност пред таа да биде вградена во системот. „Амазон“, на пример, еднаш користеше алгоритам за вработување што ги исфрли биографиите поднесени од жени затоа што беше обучен главно за оние што се поднесени од мажи. Ова можеби немаше да се случи ако повеќе жени работеа на тој систем во „Амазон“. Алгоритмите што скенираат рендгенски снимки на граден кош се покажа дека систематски им даваат недоволна дијагноза на женските пациенти, се наведува во книгата „Невидливи жени“ од Каролин Криадо-Перес, затоа што толку многу медицински модели на вештачка интелигенција се обучени на податоци што ги внесуваат мажи.

Последната серија на генеративни алатки за вештачка интелигенција е исто толку неверојатна. Генераторите на слики направија жените да изгледаат посексуално од мажите, додека истражувачкиот извештај на „Блумберг њуз“ покажа дека „Стејбл дифужн“ (Stable Diffusion), создавач на слики со вештачка интелигенција со отворен код, има тенденција да заборави дека жените дури и постојат. Тој создаде трипати повеќе слики на мажи отколку на жени. Мажите доминираа на сликите на добро платените професии, како што се инженерите, извршните директори или лекарите, додека жените беа прикажани на ниско платени работни места, како што се собарки и касиерки.

Ништо од ова нема да ги изненади истражувачите на вештачката интелигенција што се запознаени со наследството на објективизирање на жените во оваа област. Дури и пред неодамнешниот бум на генеративната вештачка интелигенција, академиците знаеја како да ги тестираат перформансите на нивните модели користејќи ги за да направат слики од женски лица или со замена на нивните фармерки со мини-здолништа, според неодамнешниот блог-напис на Саша Лучиони, истражувачка на компанијата за вештачка интелигенција со отворен код „Хагинг фејс“ (Hugging Face).

Bloomberg

Bloomberg

Секогаш кога зборува за овие методи, Лучиони вели дека наидува на отпор. „Сепак, тоа е само репер“, пишува таа, истакнувајќи дека во академската средина жените се еднакво недоволно застапени, или само 12 отсто од истражувачите за машинско учење.

Ова е еден вид сложен проблем за кој се потребни години за да се реши благодарение на неговите корени во образовниот систем и системските културни норми. Но „Опен еј-ај“ и сличните компании би можеле да спречат многу од денешните напори за изедначување на полето за игра, како што е доведување повеќе девојки и жени во СТЕМ-индустриите, доколку нивните системи продолжат да ги овековечуваат стереотипите. Искоренувањето на пристрасноста во податоците што ги користат за обука на нивните алгоритми е еден чекор кон решавање на проблемот. Другиот е едноставно ангажирање повеќе женски истражувачи за да се реши хроничната нерамнотежа. Очекувајте нивните идни производи да бидат поморничави - па, дури и штетни - ако не го прават тоа.

.png)